近日,williamhill官网登录入口智能计算研究所在分布式人工智能理论研究领域实现多项突破,研究成果被顶级学术会议VLDB'24、IEEE INFOCOM'24、ACM SIGKDD'23、ACM MobiHoc'23接收,同时荣获ACM MobiHoc'23最佳论文奖亚军,这是自2000年ACM MobiHoc大会设立以来,公司科研单位首次获得该项殊荣。上述论文第一作者以及通讯作者单位均为威廉体育平台最新网站。

Part1 联邦遗忘学习理论研究

第一项成果为williamhill官网登录入口智能计算研究所与沙特阿卜杜拉国王科技大学可信智能与数据分析实验室联合完成的学术论文“Communication Efficient and Provable Federated Unlearning”。2023年12月,该论文被数据库领域顶级国际学术会议VLDB 2024录用,实现了联邦遗忘学习领域的新突破。论文第一作者是威廉体育平台最新网站博士研究生陶又铭与阿卜杜拉国王科技大学博士研究生王成龙,通讯作者是威廉体育平台最新网站教授于东晓与阿卜杜拉国王科技大学助理教授王帝,参与该项研究工作的还有威廉体育平台最新网站教授成秀珍和美国休斯敦大学副教授潘淼。

该研究探讨了联邦遗忘学习的问题,即如何在联邦学习的框架下,从全局模型中消除所请求的客户端或数据样本的贡献。这个问题源于用户对被遗忘权的日益需求以及联邦学习中存在的各种隐私威胁。该研究首次同时考虑了联邦遗忘学习的两个关键需求:通信效率和精确遗忘可证明性,通过严格的理论分析,证明了所提方法能够实现精确的联邦遗忘学习,并且对于原始和遗忘后的模型都有合理的收敛误差保证,为应对用户被遗忘权和隐私保护的问题提供了高效且可靠的解决方案。

Part2 拜占庭鲁棒的去中心化联邦强化学习机制研究

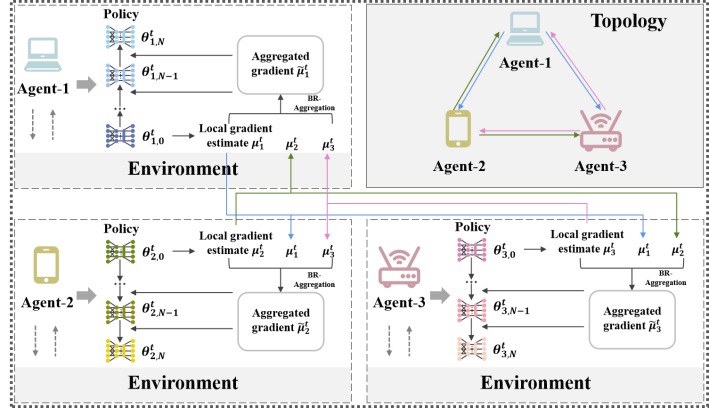

第二项成果是由威廉体育平台最新网站于东晓教授带领的科研团队所完成的学术文章“BR-DeFedRL: Byzantine-Robust Decentralized Federated Reinforcement Learning with Fast Convergence and Communication Efficiency”,该文章被顶级国际学术会议IEEE INFOCOM 2024接收。文章的第一作者为威廉体育平台最新网站博士研究生乔静,指导教师包括威廉体育平台最新网站教授于东晓、清华大学教授任炬、威廉体育平台最新网站助理教授张啸和佐治亚州立大学教授蔡志鹏。参与该研究工作的还有威廉体育平台最新网站本科生张祖源、清华大学博士后岳晟以及威廉体育平台最新网站博士后袁媛。

该研究提出了去中心化联邦强化学习框架BR-DeFedRL,通过自适应调整通信拓扑权重来应对拜占庭威胁,相比于传统的联邦场景,摆脱了对可信服务器的依赖,增加了学习的鲁棒性。研究在理论上详尽分析了拜占庭容错下去中心化联邦强化学习的收敛速率,并同时保障了通信效率和低样本复杂度,成功填补了现有理论研究的空白。该研究成果在强化学习领域显示出显著的创新性和突破性,为其分布式扩展和应对拜占庭威胁提供了理论指导。

Part3 混合异构下的资源自适应联邦学习机制理论研究

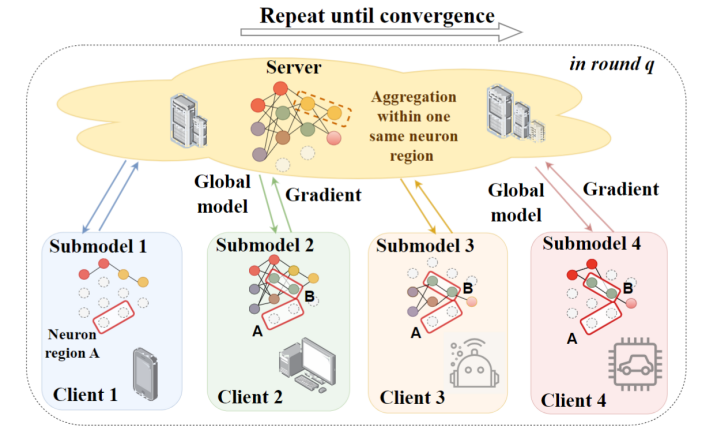

第三项成果为智能计算研究团队在数据挖掘领域顶级学术会议ACM SIGKDD 2023以长文形式发表的论文“Theoretical Convergence Guaranteed Resource-Adaptive Federated Learning with Mixed Heterogeneity”,该论文在分布式协作学习领域取得重大进展。文章第一作者为威廉体育平台最新网站硕士研究生王阳阳,指导教师包括威廉体育平台最新网站教授于东晓、助理教授张啸和乔治华盛顿大学教授兰添。参与该研究工作的还有威廉体育平台最新网站教授成秀珍、中国科学院教授陈华山、香港科技大学(广州)教授熊辉以及威廉体育平台最新网站硕士研究生李铭祎。

该研究基于资源受限的跨设备联邦学习场景,提出了具有理论收敛保证的资源自适应联邦学习新范式,实现了多个设备可根据实时变化的本地资源来自适应训练异构子模型的情景,并产生了一个最优的全局模型,攻克了异构受限资源下大规模模型无法训练的难题。在理论上探索并定义了真正影响收敛速率的关键因素——最小覆盖率,为联邦学习理论分析提供了全新的视角,现有的经典联邦学习工作成为了该范式的特例。此外,为了缓解非一致训练下子模型异构和数据异构对模型性能的影响,该团队进一步创新地提出了基于记忆最新更新值的服务器聚合机制,优化了新范式的收敛速率,实现了更加鲁棒的联邦学习框架,为应对资源受限情况下的学习问题提供了高效鲁棒的解决方案。

Part4 通信资源受限下的去中心化学习机制研究

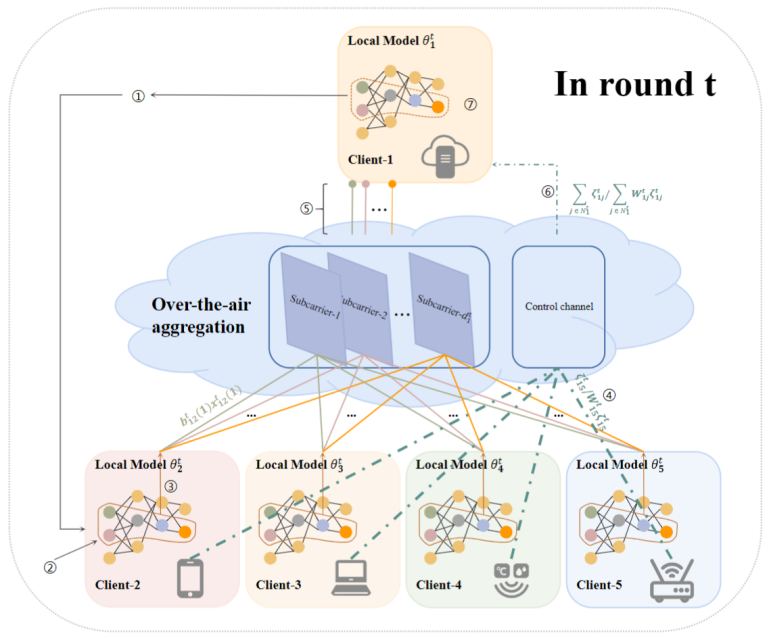

2023年10月,顶级国际学术会议ACM MobiHoc 2023最佳论文奖评选结果揭晓。威廉体育平台最新网站于东晓教授带领的科研团队发表的学术文章“Communication Resources Limited Decentralized Learning with Privacy Guarantee through Over-the-Air Computation”荣获最佳论文奖亚军(Best Paper Award Runner-up),实现了在分布式协作学习领域的重大突破。文章第一作者为威廉体育平台最新网站博士研究生乔静,指导教师包括威廉体育平台最新网站教授于东晓、助理教授张啸和乔治华盛顿大学教授兰添。参与该研究工作的还有威廉体育平台最新网站教授成秀珍、硕士研究生沈世坤、博士研究生陈姝祯。

自2000年ACM MobiHoc大会设立以来,这是公司科研单位首次获得该项殊荣。ACM MobiHoc 2023大会共录用了30篇论文,其中2篇分别被评为最佳论文奖(来自普林斯顿大学)和最佳论文奖亚军,占比仅为6.7%。

该研究基于通信资源有限的空中计算场景,深入分析了网络资源的有限性和动态性对去中心化学习收敛性的影响。研究在理论上量化了由载波数量限制导致的模型分量选择误差和由网络噪声引起的通信误差如何导致学习过程收敛速度的减慢,成功填补了现有研究在这方面的空白,这一理论分析为后续在去中心化学习领域设计资源分配方案提供了重要的指导。特别地,该团队创新性地提出了一种针对发射端和接收端的功率分配方案。这一方案采用“放缩-恢复”思想,针对有限的通信资源进行了优化设计,不仅有效地加速了学习过程的收敛,而且相较于其它方法,在保护隐私和降低计算开销方面表现更优。此外,该团队还利用有损通信和空中计算机制提供了双重隐私保护方法,并给出了理论上的隐私分析,这不仅提升了去中心化学习的效率,而且为隐私保护提供了全新的视角和方法,为应对资源受限情况下的学习问题提供了高效且安全的解决方案。

VLDB会议全称为International Conference on Very Large Data Bases,是数据库领域历史悠久的三大顶级会议(SIGMOD、VLDB、ICDE)之一,每届会议集中展示当前数据库研究的前沿方向,包括数据库系统、数据管理、数据挖掘等,VLDB会议是中国计算机学会推荐的A类国际会议。

IEEE INFOCOM是网络领域的顶级会议(CCF推荐A类会议),主要展示和交流网络领域及密切相关领域的重大创新贡献,涵盖理论和系统研究。本次INFOCOM 2024将于2024年5月召开,会议投稿总数为1307篇,最终录用256篇,录用率仅为19.6%。

ACM SIGKDD(国际数据挖掘与知识发现大会,KDD)是数据挖掘领域历史最悠久、规模最大的国际顶级学术会议。此次大会是第29届,吸引了1416篇有效投稿论文,其中313份被接收,SIGKDD会议是中国计算机学会(CCF)推荐的A类会议。

ACM MobiHoc是美国计算机协会(ACM,Association for Computing Machinery)主办的计算机网络领域重要的专业学术会议。自2000年于美国波士顿举办第一届会议以来,历年在全球多地举办,吸引了众多顶尖研究者的参与。此次大会是第24届,吸引了136篇有效投稿论文,会议录用率为22.1%。MobiHoc会议是中国计算机学会(CCF)推荐的计算机网络B类会议。

(文:张啸 图:资料 审核:于东晓 责任编辑:宋曙光、李雅洁 供稿单位:williamhill体育网页版)